마산에서 저어새를 찍음으로써, 한 가지 취미가 확실해졌다.

새를 관찰하는 일이 즐겁기 그지 없구나!

그렇다면 투자를 조금 더 해서 탐조용 카메라를 맞춰볼까?

바로 "탐조 입문용 카메라 추천"을 검색해보았다.

카메라 사는 것은 바로 포기했다.

아니 21세기의 20%가 지난 2021년에, 100배 줌이다 뭐다

"카메라 휴대폰으로도 이렇게 찍을 수 있구나" 난리법석 왁자지껄한데

새 좀 찍는 카메라에 100만은 택도 없다는 게 현실인가? 믿기지 않는다.

그래서 과학의 힘을 빌려보기로 했다.

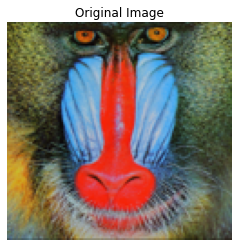

2018년 9월에 발표된 ESRGAN이라는 논문이

Tensorflow 블로그에 잘 설명되어 있어서 "이거다" 싶었다.

살짝 오래되었다는 점이 흠이지만,

일단 시험삼아서 해본 뒤에 차차 발전시켜 나가면 될 일이다.

내가 찍은 저어새 사진의 원본은 위와 같다.

아이폰 SE 1세대로 최대한 줌을 땡겨서(5배 디지털 줌이지만...) 찍은 결과인데

생각만큼 나쁘지는 않다.

새들이 도망가지 않을만큼 멀리 떨어져 있었음에도

여기서 줌을 더 당겨보면 아래 사진을 얻을 수 있는 정도이다.

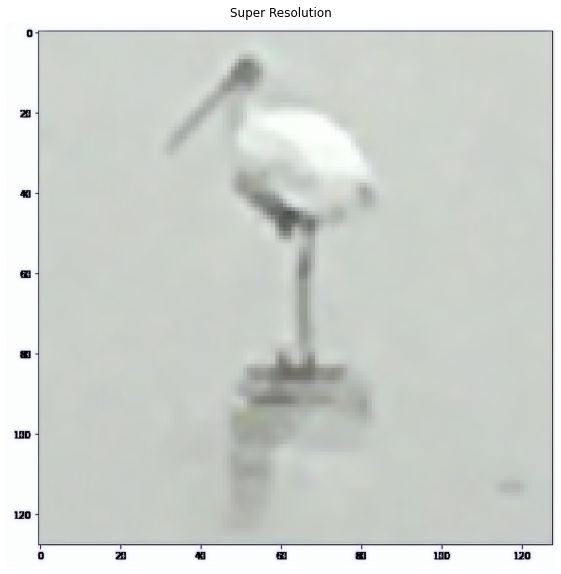

ESRGAN으로 구할 수 있는 해상도 업그레이드는 또 아래와 같다.

털 하나 하나, 색감 등이 잘 살아난 것 같아 기대감을 높였다.

그래서 원본 사진을 그대로 적용해서 코드를 돌리려고 하니 오류가 났다.

찬찬히 코드를 살펴보고서 다음과 같은 문구를 볼 수 있었다.

128 x 128 크기의 패치에서 훈련된 모델이라면,

해상도가 만 단위인 것이다.

아이폰 SE 1세대라도 후면 카메라는 1200만 화소인데다가

5배 줌을 해도 240만 화소는 되는데

만 화소 따리 AI가 정녕 인공지능인 것인가?

좌절하기 전에, 우선 오류부터 해결해보기로 했다.

일단 128x128 사이즈로 맞춰줄 필요가 있었다.

이미지를 자른다고 잘라봤지만, 화질이 떨어지는 것은 어쩔 수가 없었다.

다음에는 저어새 한 마리만 잘라다가 테스트를 해보는 것도 나쁘진 않을 것 같다.

어쨌든 위 이미지로 ESRGAN을 돌린 결과는 아래와 같다.

응?

머릿 속에 무수히 많은 물음표가 찍히는 것을 뒤로 한 채,

찬찬히 살펴보니, 아주 조오오금 화질이 개선된 것 같기도 하다.

물론 그렇게 생각하고 봐서 그렇게 보이는 것일 수도 있다.

원래 이쯤에서 끝내려고 했는데,

저어새 한 마리만 잘라다가 다시 테스트 해보기로 했다.

역시 택도 없었다.

이번에는 화질이 개선되었다는 느낌조차 받을 수가 없었다.

색조만 조금 톤다운 된 것 같은 느낌만 들 뿐이다.

다음에는 더 나은 알고리즘을 찾아서 적용해봐야겠다.

'트렌드 한눈에 보기 > 학계 트렌드' 카테고리의 다른 글

| PyTorch를 활용한 DQN tutorial - 2탄 (0) | 2021.01.29 |

|---|---|

| PyTorch를 활용한 DQN Tutorial - Pytorch vs Tensorflow (0) | 2021.01.27 |

| 한국 정부에서 1600억을 들여 개발 중인 아이언맨 슈트 (0) | 2021.01.19 |

| PyTorch 튜토리얼, 60분 내로 끝낼 수 있을까? (0) | 2021.01.18 |

| [CS234] Lecture 16: Monte Carlo Tree Search 정리 (0) | 2021.01.14 |